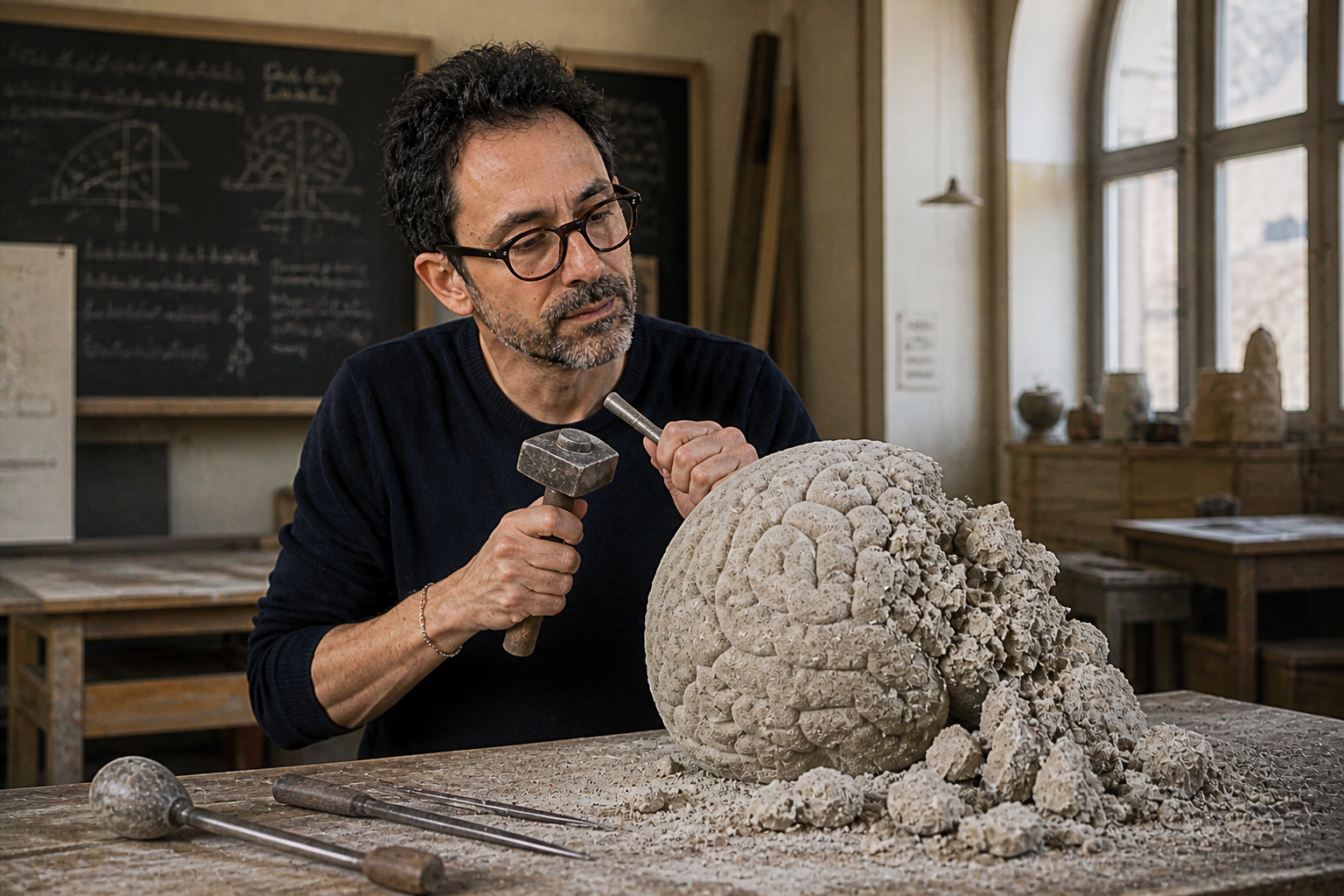

Ce que l'IA fait à votre cerveau (et pourquoi ça devrait vous inquiéter)

J'utilise des assistants IA pour coder tous les jours. Et je vous avoue que je commence à m'inquiéter de ce qu'ils font à mon cerveau. Pas du remplacement, ce débat est derrière nous. De ce qui se passe entre deux prompts, dans le silence intérieur où s'effrite, sans bruit, ma capacité à réfléchir lentement.

Trente secondes

Trente secondes devenues insupportables...

Quand Claude Code met trente secondes au lieu d'une à me répondre, je sens monter une impatience que je ne me connaissais pas. Plus souvent que je ne voudrais l'admettre.

Je ne suis pas un cas isolé. Depuis quelques semaines, des études donnent une forme à cette angoisse diffuse que partagent beaucoup de développeurs et de cadres devenus accros à l’usage de l’IA. Et ce qu'elles décrivent ressemble moins à une révolution productive qu'à un piège comportemental dont nous sommes les complices enthousiastes.

Le phénomène est même dangereusement accéléré par ce que dans la Silicon Valley on appelle le tokenmaxxing. Chez Microsoft, Shopify ou OpenAI, des classements internes comparent les développeurs qui consomment le plus d'IA. Pas ceux qui produisent le meilleur code. Ceux qui en consomment le plus. Selon le New York Times, un ingénieur d'OpenAI a brûlé 210 milliards de tokens en une semaine, soit 33 fois Wikipédia. Un utilisateur de Claude Code a fait grimper sa facture à 150 000 dollars sur un mois.

Le mot maxxing, venu de la culture en ligne, dit tout : pousser un comportement jusqu'à l'absurde. Et derrière l'absurde, trois symptômes qui devraient nous alerter.

Premier symptôme : l'intolérance à la friction

Le plus pernicieux est aussi celui dont on parle le moins.

Quand le cerveau s'habitue à obtenir des réponses complexes en quelques secondes, il recalibre sa notion du temps normal. Ce qui prenait dix minutes de réflexion devient insupportablement long. On ne patiente plus. On ne réfléchit plus. On exige.

Cette intolérance à la friction cognitive contamine tout. Un email à écrire ? On le génère plutôt que de poser sa pensée. Un problème à analyser ? On le prompte avant même d'avoir formé sa propre opinion. Une décision à prendre ? On demande une liste d’avantages et d’inconvénients à l'IA, comme si la décision elle-même pouvait être déléguée.

Ce qui s'érode, c'est ce que Daniel Kahneman appelait le Système 2. La pensée lente. Celle qui gratte, qui doute, qui construit une compréhension profonde au prix d'un inconfort temporaire. À la place, le Système 1 tourne en boucle, alimenté par une dopamine à haut débit. Et le pire : on se sent terriblement productif.

Une équipe de Carnegie Mellon, Oxford, MIT et UCLA vient de publier la démonstration la plus solide de ce phénomène. Trois essais randomisés contrôlés, 1 222 participants : après seulement dix à quinze minutes d'assistance par IA, ceux qu'on en prive ensuite performent moins bien et abandonnent plus vite que ceux qui n'y ont jamais touché.

Le mécanisme identifié est exactement celui que je ressens : la persévérance diminue. L'IA conditionne ses utilisateurs à attendre des réponses immédiates et les prive de l'expérience de traverser une difficulté seul. Or la persévérance, écrivent les auteurs, reste « l'un des prédicteurs les plus forts de l'apprentissage à long terme ». Si dix minutes suffisent à l'éroder, qu'est-ce que des années d'usage quotidien nous préparent ?

Deuxième symptôme : la machine à sous

Le deuxième mécanisme est plus connu, mais sous-estimé. Il porte un nom dans la littérature comportementale : le renforcement à ratio variable. C'est lui qui rend addictifs les jeux d'argent, les notifications Instagram et Candy Crush. Le principe : la récompense arrive à intervalles imprévisibles. Parfois le code fonctionne du premier coup. Parfois il plante. Parfois il fait quelque chose d'étrange et de merveilleux qu'on n'aurait jamais écrit soi-même. Cette imprévisibilité libère plus de dopamine qu'une récompense fixe : c'est l’aléa qui rend accro. Une étude de Zald et al. (2004) au PET a montré, déjà à l'époque, que les récompenses à ratio variable activent le striatum bien plus intensément que les récompenses prévisibles.

« Le code marche. C'est génial . Il vient de casser. WTF !!! » Vous reconnaissez le phénomène ? Ce va-et-vient permanent entre succès et échec maintient le cerveau en excitation cognitive constante. Et le coût d'entrée est dérisoire : taper une phrase, appuyer sur Entrée. Les neuroscientifiques parlent d'effort discounting : le cerveau surévalue la récompense potentielle par rapport à l'investissement réel. Combinez ça à ce besoin compulsif de finir ce qu'on a commencé, et vous tenez le mécanisme exact d'une session de six heures qui devait en durer une.

Troisième symptôme : le business model qui en rajoute

Il y a un troisième facteur, plus cynique, et il est central pour comprendre pourquoi le piège va se refermer plutôt que s'ouvrir.

La plupart des assistants de code facturent au token, c'est-à-dire au volume de texte traité. Plus le code est verbeux, plus l'éditeur encaisse. Et les modèles ont une tendance structurelle à sur-ingénier : code ultra-défensif, commentaires saturés, fonctions auxiliaires à peine utiles.

Les chiffres financiers racontent l'histoire. Le revenu annualisé de Claude Code a doublé en deux mois début 2026, atteignant 2,5 milliards de dollars. Anthropic dans son ensemble est passée de 9 à 19 milliards d'ARR en moins de quatre mois, puis à 30 milliards en avril. Les éditeurs n'ont aucun intérêt structurel à résoudre la verbosité de leurs modèles. Comme l'écrivait Upton Sinclair en 1934 : « Il est difficile de faire comprendre quelque chose à quelqu'un quand son salaire dépend du fait qu'il ne le comprenne pas. » Tant que tous les éditeurs facturent pareil, l'incitation à l'efficience reste molle.

Nous payons donc, littéralement, pour recevoir plus de code que nécessaire, code qui érode notre capacité à coder nous-mêmes. Le modèle économique pousse exactement dans la direction inverse de notre intérêt cognitif.

Trois garde-fous à poser tout de suite

Je ne plaide pas pour l'abandon des assistants IA. Ce serait aussi absurde que de militer contre l'électricité, et je serais le premier à trahir mon propre conseil. Mais il y a des garde-fous qu'il faut poser, individuellement et collectivement, avant que l'érosion ne devienne irréversible.

Premier principe : ne jamais accepter un code qu'on ne comprend pas. Ce qui est valable pour le code l’est pour n’importe quelle production IA. Évident ? Pourtant les témoignages montrent que même des développeurs chevronnés sautent cette étape. La fatigue de la friction l'emporte sur la rigueur.

Deuxième principe : alterner sessions assistées et sessions non assistées. Comme un sportif alterne musculation et cardio. La compétence technique est un muscle. Si on ne l'utilise pas, il fond. Les meilleures études d'apprentissage montrent que ceux qui s'en sortent le mieux utilisent l'IA comme un tuteur qui explique, pas comme un exécutant qui produit.

Troisième principe : se méfier du sentiment de vitesse. La productivité apparente masque une dette cognitive aux intérêts composés. La bonne question n'est pas « est-ce que ça va plus vite ? » mais « est-ce que je deviens meilleur ? ». Les deux réponses divergent souvent.

Le vrai dilemme

Le débat n'est plus de savoir si l'on utilise l'IA, mais comment, et à quel prix neurologique.

Ces outils ne se contentent pas d'augmenter notre productivité : ils reconfigurent nos circuits cognitifs, dressent notre attention au rythme de la dopamine, désapprennent à nos cerveaux la lenteur de la pensée.

Une nouvelle frontière s'ouvre pour la recherche en santé mentale. Comprendre comment nos cerveaux se remodèlent au contact des LLM, mesurer ce qui se rétablit et ce qui ne se rétablit pas, distinguer les usages qui éduquent de ceux qui érodent : c'est sans doute l'un des grands chantiers scientifiques de la décennie. Les machines à sous sont conçues pour qu'on perde la notion du temps. Les assistants IA sont conçus pour qu'on perde la notion de l'effort. La différence, c'est qu'on peut choisir de les utiliser autrement.

Sources :

Kevin Roose, « Tokenmaxxing », The New York Times, 21 mars 2026.

The Information, enquête sur le leaderboard « Claudeonomics » de Meta, avril 2026.

Grace Liu, Brian Christian, Tsvetomira Dumbalska, Michiel A. Bakker, Rachit Dubey, AI Assistance Reduces Persistence and Hurts Independent Performance (Carnegie Mellon, Oxford, MIT, UCLA), arXiv:2604.04721, avril 2026.

Nataliya Kosmyna et al., Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task, MIT Media Lab, arXiv:2506.08872, juin 2025.

D. H. Zald et al., « Dopamine Transmission in the Human Striatum during Monetary Reward Tasks », Journal of Neuroscience, 2004.

Sacra, Anthropic revenue, valuation & funding, mise à jour avril 2026.

Gergely Orosz, The Pulse: Tokenmaxxing as a Weird New Trend, Pragmatic Engineer, avril 2026.

Upton Sinclair, I, Candidate for Governor: And How I Got Licked, 1935.

Découvrez QAPTEN ASSISTANT

L'assistant IA qui travaille pour vous, pas seulement avec vous !

QAPTEN ASSISTANT vous aide à faire avancer les choses.

Ce n'est pas un chatbot de plus — c'est un vrai assistant opérationnel. Parlez-lui dans Telegram comme à un collègue. Il comprend, retient, se connecte à vos outils et exécute des tâches utiles au quotidien.